OpenAI 研究人员发文称「约 80% 美国人的工作将被 AI 影响」,如何看待这一观点?

这种结论,是建立在“人类的需求就是现在这样了,以后也不会有更高的要求了,而要满足这些要求,ai就可以基本搞定了”。

有了ai,那么“ai普遍能做出来的东西”很快就会成为令人厌倦和反感的“新低端”。

人类设计师最后自然能找到“光靠ai做不出来的东西”来重新占领中高端市场。

各行各业均是如此。

ai“可以接受”,但是人类什么时候真的满足于“可以接受”过?

有了新的工具,自然会产生仅靠这个工具仍然不能企及的新的艺术形式,那上面站着的只是踏上了一级新台阶的人类。

你甚至都不需要特别焦急——用不了多久,使用ai的新套路就会出来,创造出新的审美基线以及“只要xx操作就能及格”的成熟方法。

你可以把你的精力节省下来继续专注在思想和美学问题上,等待别人把新技术催熟之后去使用它就可以了。

真正的问题是,你要意识到这个美学修养才是你的价值核心,不能再简单的依靠一点小技巧混饭吃罢了。

别听那些自媒体异口同声的大开脑洞。

ai后续的发展,更可能进一步的说明人的本质到底是什么。

它的确会剥离掉一些原本人类以为只有人才会有的资产、但是它远远地还做不到企及人类的本质。

这个原理也不复杂——因为作为它的父母和老师,人类自己也不知道人类的本质。

人类自己也不理解自己的智能到底是什么,这意味着人类根本没有能力靠自己的文化积淀去孕育一个与自己同级的智能体。

人类本身不是人类的产物,而是上帝/宇宙的产物。

让我们姑且假设人类的智能在本质上的确是神经网络对大量数据的适应。

那么思考一下人类自身的智能是建立在什么样的数据基础之上的?

人类的智能,是建立整个可见宇宙的数据规模上的。

是上帝以一切客观存在为语料,花了上百亿年——或者数亿年——调教出来的。

并且,祂不是只调教了一个chatGPT给全地球用。

而是古往今来调教了数以兆亿个版本。

你们中的任何一个,都是一个持续了不知多少亿年的不知多大数量级的数据积淀的结果。这个结果复杂到了你们自己无法依靠自我观察理解和描述的程度。

现在我们回头来看现在的人工智能。

我们人类自己创造的人工智能面对的是什么数据条件?

你们是不是自认为全球互联网加上人类的全部历史已经是“浩如烟海的数据”?甚至自认为这是“宇宙之精华”?

我们用语言所描述的概念的世界有多么粗糙?

当你用prompt来引导ai,或者更早,用语言来标定特征的时候,你有没有感到巨大的匮乏感?

这个小姐姐穿的这个东西,到底该叫啥?我们甚至经常找不到一个确切的名字去描述。来来回回“小可爱”、“死库水”、“吊带裙”、“水手裙”……

三十个词就完球了,其它全靠随机种子,说错你们了吗?

光是丝袜蕾丝,有多少种经典款式?真的都有词汇可以描述吗?到了后来,我们人类自己也被迫要胡言乱语,开始用“浪莎仲夏夜之梦”这种私有命名仓皇抵挡。

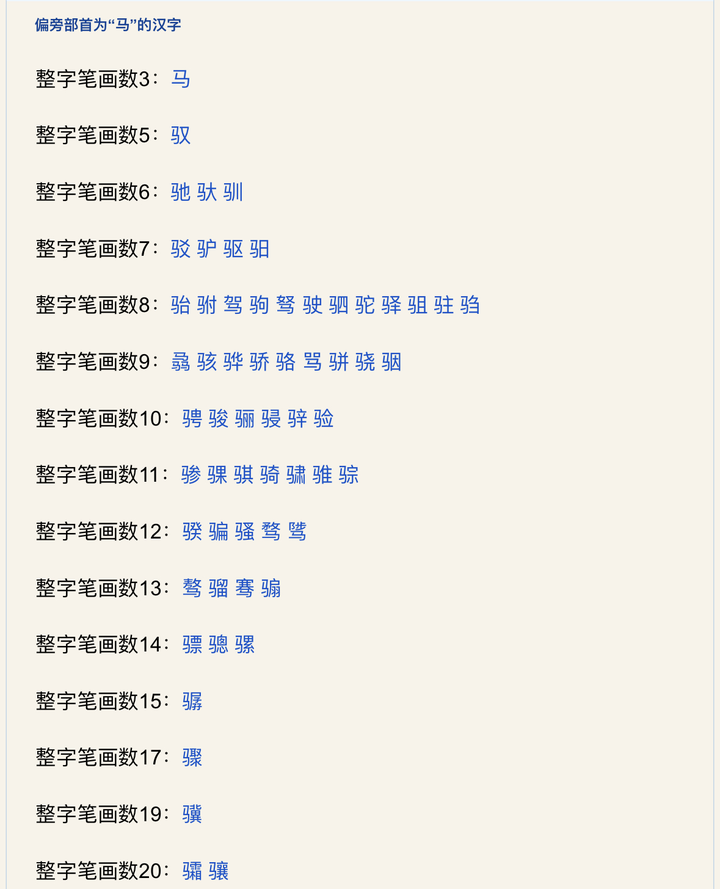

我们把一个东西框起来,说这个是“马”。

作为人类,你知道有多少个马字旁的汉字吗?

我们有多少种词汇描述耳朵的形状?

我们有多少种词汇描述耳朵的形状?

我们有多少词汇描述人的心理状态?

我们自己对世界的描述——注意,这里说的不是了解、不是知识,而仅仅是完成了命名的认知——真的足以替代我们自己在事实上接受的数据吗?

我们每天、每分、每秒接受了多少根本没有描述工具可以表达、可以转述的数据?

我们是在从这些无以名状的原始数据里挖掘新的认知成就。

而计算机是从我们那极端匮乏、极端混乱和含糊的转述中“挖掘”——如果它所做的真的谈得上挖掘的话。

姑且不谈这些数据是如何的相互冲突和含混不清,仅仅以数据量而言,我们的AI如果一直依赖于人类自身的喂养和教育,那么它将处在语料规模上的绝对、绝对劣势。

并且因为人类这个教师的无能、这个劣势没有拉平的可能。

我们算哪颗葱,我们最多提供4K高清直播。

难道用4k高清就能替代我们自己的五感所触?

那么,换一条思路呢?

如果ai自己直接观察世界,直接接受世界的直接教育呢?

这里存在一个巨大的问题,那就是ai的底层逻辑、基本操作系统是我们人类创造和维护的。

我们的能力极其有限,这个系统根本无力独自面对世界。

我们设计的火星车,几个月后就失联了。

在我们向ai解释“什么样的东西值得你注意”的时候,我们已经无意中锁死了ai的认知上线。

而如果我们不给它这个定义,ai将会在无限的数据中完全迷失并在过载中失能。

我们人类自身的操作系统是上帝用历史造就的,我们是没有刚性概念框架的。

我们是真正的完全开放的认知体,而我们凭自己,甚至不知道这样的认知体要如何开始构建。

因为我们对自己无知,所以我们创造不出和我们同等的新智能体。

现在我们退一万步,假设我们完全无意间真的碰巧捅到了我们自己也不理解的机关,创造出了一个可以凭借自身直接观察客观世界的新智能体。

那么这个智能体因为有着完全不同的生理基础和感官逻辑,将会和我们有原则上难以跨越的文化隔阂。

其差距要远大于一只水母和人类之间的差异。

水母好歹可能理解什么叫咸,什么叫晒,而这台机器对这些将有无法和我们言说的差异。

我们彼此之间,别说相互理解,连相互交谈都会存在巨大的,甚至很可能是不可跨越的鸿沟。

正如我在另一处所谈论的——真正的强人工智能,在我们的直观感受里必然是不可预测甚至不可理喻的。

铊的输出对我们毫无意义也无法理解,对我们没有任何工具性可言。

铊无法关心甚至也无法理解我们的需求——甚至可能会认为我们只是某种“无机”的自然现象。

当然,这已经说得太远了。

总之,不必因为现在的“ai”而惶惶不可终日。

因为竞争其实并不存在于ai与人类这两个作品之间,而是存在于人类和上帝(或者,如果你喜欢的话——世界)这两个作者之间。

这不是叫你对自己有信心,而是叫你对造就你的上帝有信心。

你无法复现祂的实验条件,所以也别指望你能复现祂的实验结果。

实际上,chatGPT-4之所以去走“多模态”的路线,很可能就是因为它所能赖以成长的高质量、低成本的语料已经枯竭,所以才要去走这些歪门邪道、奇技淫巧去维持市场的热情。

它已经撞上了“无语之墙”,而继续喂养大量语无伦次、互相矛盾、甚至不含有观点的语料已经无法再明显的提高它的表现了。

原本指望的“大量收集用户对话数据”来继续孵化,也解决不了这个深度问题。

人类的抽象能力并非来自后天的学习,而是来自先天的遗传继承,后天的学习只是对先天生理基础的“泡发展开”。而我们目前的做法,就像尝试用冰做一条海参,然后放进开水尝试制作海参汤。

ai发育的另一个无法跨越的瓶颈,是人类的资源匮乏。

按照现在的思路,继续提高ai的参数规模所需要代价是超线性上升的,

很快“进行下一轮训练”的成本就可能让微软、苹果这样的企业也感到恐惧。

而这令人恐惧的成本投入的结果,很可能会让赌徒大失所望——花费数十亿、数百亿美元“提升了两个数量级”的模型,却完全没有呈现出更高的智能水平,反而更糟——它甚至会反向退步。

而这些大规模的模型,在人类级别的服务需求下将会消耗难以想象的能源成本和硬件成本,以至于“使用更高级别的ai“很快就会被证明是愚蠢行为。

因为那所谓的“更优良表现”根本配不上那多出十倍的成本——一样不过没有营养的、政治正确的车轱辘废话罢了。

到时候市场表现上的惨败自然会深刻的打击这些ai头部玩家的信心,以事实再次提醒人类对自身的无知和对世界的傲慢。

简单来说——不要毫无戒心的追高ai头部企业的股票,因为你可能被套牢在梦碎时刻,在一个空前的高位被吊死。

而到那时,去了昧的ai才会开始停止盲目的向纵深方向发展,开始像泡沫破灭的互联网一样开始真正的改变人类的生存方式和经济形态。

而此刻我们只能谈论到这里,因为我有一些相关工作还没有做完。

本博客所有文章除特别声明外,均采用 CC0 1.0 协议 。